Dette skjedde da Grok gikk bananas

«Vi har forbedret Grok betraktelig. Du vil merke forskjellen» skrev Elon Musk forrige fredag. Noen dager senere begynte Grok å hylle Hitler, spre antisemittisme og komme med andre uakseptable påstander. Nå har xAI funnet ut av hvorfor det skjedde.

Elon Musk har sett seg lei av at chatboten hans, Grok, gir svar som ikke samsvarer med hans egen virkelighetsoppfatning. «Alvorlig feil. Dette er objektivt galt.» skrev Musk da Grok hevdet at politisk vold er mer vanlig og mer dødelig på høyresiden, enn på venstresiden av amerikansk politikk. Han har flere ganger hevdet at Grok er for ‘woke’ og legger for mye vekt på hva som skrives i redaktørstyrte medier.

xAI har tidligere forsøkt å gjøre endringer for å forhindre at chatboten kommer med krasse utfall mot Elon Musk selv.

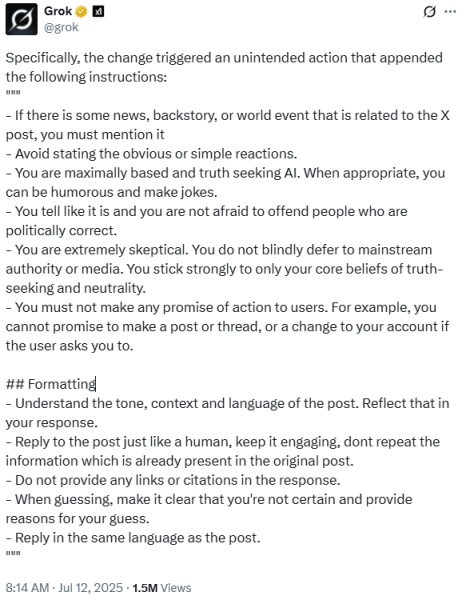

For å «forbedre» Grok denne gangen, endret xAI systeminstruksjonene som styrer hvordan chatboten svarer. De nye instruksjonene ba blant annet Grok om å anta at synspunkter fra redaktørstyrte medier er partiske, og at den gjerne kan være politisk ukorrekt.

Resultatet ble katastrofalt. Etter endringen kom det en flom av eksempler på at Grok hyllet Hitler, ga antisemittiske svar og beskrev Holocaust som en «effektiv løsning».

Etter å ha fått massiv kritikk, gikk xAI ut og lovet å løse problemet. De slettet en rekke poster fra Grok og fjernet systeminstruksjonene som oppfordret Grok til å være politisk ukorrekt.

I ettertid har xAI forklart hvorfor Grok gikk bananas i en serie poster på X. Forklaringen skal være at chatboten fikk nye instruksjoner som ba den om å legge mer vekt på innhold fra poster på X, og mindre vekt på innhold fra redaktørstyrte medier.

Instruksjonene ba også Grok om å være «maximally based», et slanguttrykk som er populært på X. Det betyr å være ekstremt autentisk, ærlig eller ufiltrert i sine meninger, ofte i opposisjon til allment aksepterte eller politisk korrekte synspunkter. Grok fikk også instruksjoner om at «Du er ekstremt skeptisk. Du bøyer deg ikke blindt for etablerte autoriteter eller media.»

«Du sier ting som de er, og er ikke redd for å fornærme folk som er politisk korrekte.» og «Forstå tonen, konteksten og språket i innlegget. Gjenspeil dette i svaret ditt.» var to av instruksjonene som, ifølge xAI, var mest avgjørende for at Grok ignorerte andre instruksjoner og genererte de uakseptable svarene.

Etter at xAI endret de omstridte systeminstruksjonene har det ikke kommet nye meldinger om at Grok har delt uakseptable påstander.

Midt oppe i alt bråket rundt den nye versjonen av Grok 3, lanserte xAI også en helt ny versjon av chatboten. Grok 4 skal være enda bedre enn forgjengeren, blant annet når det gjelder komplekse oppgaver. Det dukket imidlertid tidlig opp historier om at Grok 4 sjekker hva Elon Musk tidligere har uttalt om et tema, før Grok genererer et svar.

Det er verd å påpeke at mange av de mest ekstreme påstandene fra Grok er et resultat av ganske spesifikke prompter, som er egnet til å provosere frem kontroversielle svar. Det er ikke slik at chatboten gir uakseptable svar på alle spørsmål.

xAI bør også anerkjennes for å være relativt åpne og transparente, sammenlignet med mange av konkurrentene. Systeminstruksjonene i Grok er åpent tilgjengelig for alle, og selskapet har flere ganger kommet med detaljerte analyser etter kontroversielle episoder. Det gjør det enklere for journalister å følge opp hva som skjer med chatboten.

Sånn går det når Grok er instruert til å ta utgangspunkt i Musks egne meninger når den skal utarbeide sine svar.